생성형 AI, LLM, 일반인공지능 AGI 인류 위협 가능한가? 큐스타 Q* 엔지니어와 오픈AI CEO 대립 근본 원인은 뭘까요? 최근 이사회 수석 엔지니어와 오픈AI CEO 대립의 근본 원인이 뭘까 생각해봤습니다.

- 보안이란 뭘까요? 라는 질문에 “들어오는 것을 막고, 일단 들어오면 허락없이 나가지 못하게 하는 것이다”라고 쉽게 설명하는 수준으로

- LLM 생성형AI란 뭘까요? 라는 질문을 한다면, “사용자 질문에 대하여 확률적으로 가장 높은 단어(묶음)을 나열하는 것이다”라고 말할 수 있습니다. 따라서 미리 수집해놓은 어마무시하게 거대한 수집 정보들을 가지고 확률적으로 계속 높은 단어들을 예측하여 답변을 구성하는 것에 불과하다(?) 라고 말할수 있습니다. 따라서 새로운 문제에 대한 응용이 아니라 단지 주어진 것에 대해서 확률적으로 높은 것을 추정하는 것으로 볼수 있습니다.

그간 이러한 관점에서 볼 때 별것 아니라고 생각했는데 현재 최근 오픈AI 수석엔지니어와 CEO의 대립의 근본 원인이 뭘까 궁금합니다. 이젠 그리 단순한게 아니라 진짜 인류를 위협할 만큼 강력한 인공지능 “큐 스타”를 확인하고 두려움을 느낀 걸까요? 궁금합니다.

1. “큐 스타” 을 검증하면서 알게 된게 이런 걸까요?

- 오픈AI 연구진이 개발한 더 강력한 인공지능 모델을 개발

- 몇십 배 빠른 발전 속도와 기존 모델보다 뛰어난, 무엇보다 “수학 연산 능력”을 갖춤.

- 기존 AI 모델은 통계 기반 예측에 의존하는 반면, 큐 스타는 추가 데이터 없이도 스스로 연산 문제 이해 및 해결이 가능.

- 기존 데이터셋을 응용하여 새로운 문제를 해결하는 능력을 갖춤.

2. 일반인공지능 AGI 로의 한 걸음 더 진화

- 큐 스타의 능력은 일반적인 AI에서 벗어나, AGI에 한 걸음 더 가까워졌음을 시사.

- 새로운 문제에 대한 응용 능력은 기술 혁신의 징후로 받아들여짐.

3. 경고 서한과 해임 사태

- 연구진이 이사회에 보낸 서한에 따르면, 큐 스타는 파괴적인 능력을 지닌 시스템으로 사용될 수 있고 두려움(?)을 느꼈음.

- 인류의 안전 vs. 너무 빠른 인공지능의 개발/발전 속도에 대한 경각심 필요함을 느꼈음.

- 연구진은 개발 속도에 대한 경각심을 표명하며, 큐 스타가 인류를 위협할 정도의 강력한 시스템으로 사용될 수 있음에 대한 우려를 제기.

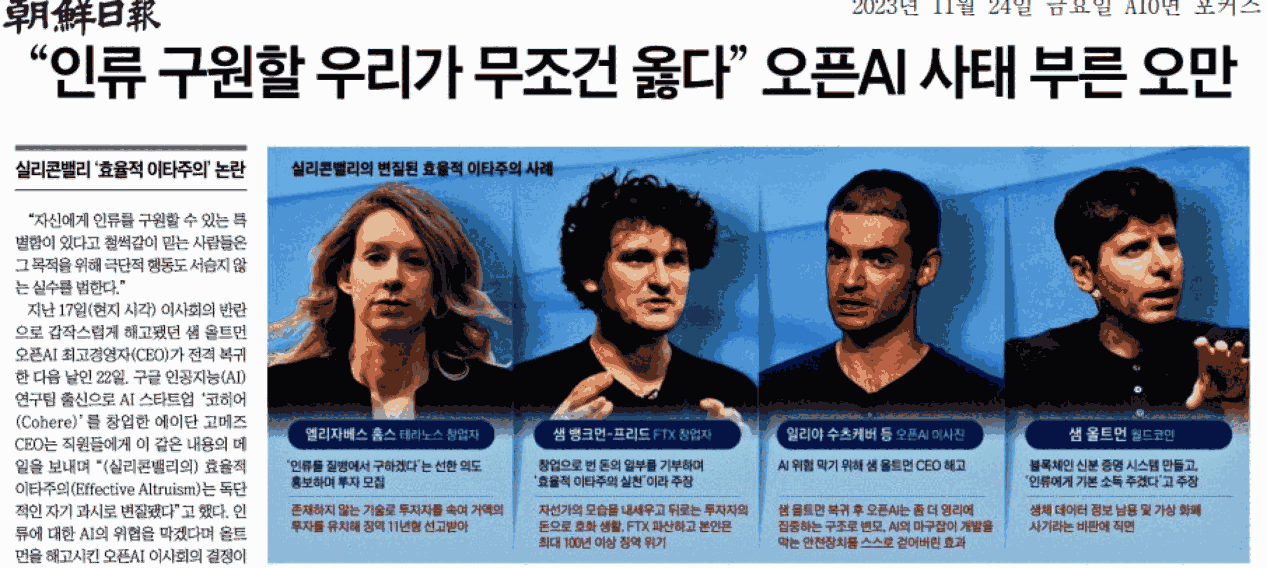

- 이에 인류의 안전을 위한 조치 및 규제 필요성을 강조하고 있고, 이에 반하는 샘 알트먼 해임 사태가 발생함.

(c)KDM컨설팅 연구소장